cdn回源网站解析什么意思对缓存新鲜度和回源压力的直接影响

什么是CDN回源网站解析?为何它决定缓存新鲜度与回源压力

1. 精华:回源并非只是“再去原站拿资源”,而是会被回源网站解析规则严格左右,直接影响缓存新鲜度与系统的回源压力。

2. 精华:通过调整Cache-Control/TTL、使用stale-while-revalidate与origin shield等策略,可以在保证内容新鲜的同时极大降低回源压力。

3. 精华:实现高效的缓存策略需要工程经验(我有10年CDN与性能优化实践),结合监控指标(如缓存命中率、origin请求/秒)持续迭代。

作为一名长期打磨边界性能的工程师,我要大声说:了解什么是cdn回源网站解析,比盲目拉长TTL更重要。这里的“解析”包含DNS层面的解析、HTTP请求头(Host、Cookie、Query)如何被CDN解析为回源行为,以及CDN如何基于这些规则决定是否命中缓存。

回源发生的典型场景包括缓存失效、缓存未命中、条件请求未通过以及强制清理。每一次回源都在向原站施压——并非抽象概念,而是会带来突发的CPU、带宽、数据库查询增量,最终导致服务不稳定。

缓存新鲜度本质上是一个权衡问题:你要么保证内容永远最新(频繁回源),要么牺牲部分即时性以换取更高的稳定性与成本效率。优秀的方案是在不牺牲用户体验的前提下,通过规则化解析与智能回源降低回源频次。

技术细节上,Cache-Control(max-age、s-maxage、public/private)、Expires、ETag、If-Modified-Since等头部直接影响CDN是否回源以及如何校验新鲜度。比如启用ETag配合304响应能减少带宽,但每次校验仍会产生回源请求,除非使用stale缓存策略。

把视线拉到CDN实现:不同CDN的回源网站解析规则不尽相同。某些CDN会把Query String、Cookie、Header等作为缓存key的一部分;有的允许按路径、按正则、按Host进行缓存粒度控制。错误配置会导致缓存零命中,回源爆表。

实践建议一:使用origin shield或中间缓存层。它能把来自各边缘节点的回源请求先汇聚到一个节点,再由该节点向原站回源,立竿见影地降低对源站的并发请求数。

实践建议二:合理设置TTL并结合stale-while-revalidate与stale-if-error。当缓存过期时,让边缘节点继续返回旧内容并在后台异步回源刷新,这样用户不会因回源延迟而受到影响。

实践建议三:按内容类型分流静态与动态资源。静态资源(图片、JS、CSS)可以极长TTL并使用版本化策略;动态页面则通过短TTL或按用户分片缓存(例如匿名用户缓存、登录用户绕过缓存)来确保精准度。

技术细节:避免把不必要的Cookie和变动的Query参数纳入缓存Key。统一化URL、剥离追踪参数(utm_*)并使用允许的缓存Key规则,可以提升缓存命中率数倍,从而降低回源率。

安全与稳定并重:为避免垃圾请求或恶意刷回源,务必在CDN层面加入签名回源、WAF限流以及origin ACL。只有信任的CDN节点能回源,能有效减少非法请求直接打穿原站。

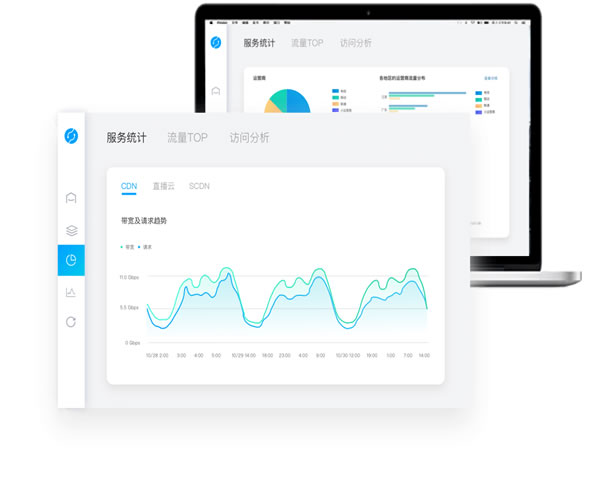

监控指标决定优化方向:实时观测缓存命中率、origin请求/秒、回源错误率(5xx)、边缘延迟与带宽消耗。以这些数据为依据做A/B调整比靠经验更可靠。目标通常是把origin请求降到峰值的10%以下。

举个例子:某电商在大促期间通过开启origin shield、优化缓存Key和增加stale-while-revalidate,成功把回源请求从峰值的50k/s降到6k/s,页面响应时间反而下降了30%。这是因为减少回源抖动、稳定了后端资源池。

注意事项:不恰当的“无限期缓存”会导致内容陈旧甚至业务损失(例如商品价格、库存)。因此对关键数据实行事件驱动的主动清理(Webhook触发CDN清理或使用缓存失效API)是必须的。

进一步的高级策略包括:分层缓存(边缘->区域->原站)、预取/预热(热门资源在流量高峰前主动回源并缓存)、以及使用渐进式回源(先回源轻量数据判断再决定是否回源重负载内容)。

最后,合规与透明度也属于EEAT:记录回源日志、保留配置变更历史,并对外给出缓存策略说明,不仅提升团队可审计性,也在审计与商业合约中作为信任凭证。

结论:掌握回源网站解析的机制、善用缓存头与CDN特性,并辅以监控与防护,能同时提升缓存新鲜度体验与降低回源压力。别再把回源当成“自然而然”的事,把它当作系统设计的一部分,你的站点将更快、更稳、更省钱。

-

2026年4月6日

CDN安全加速构建于DNS保护与证书管理的综合防护案例

CDN安全加速的核心:DNS保护 + 证书管理的综合防护 1. 精华:用DNS保护阻断流量污染与域名劫持,Anycast与DNSSEC联合防护。 2. 精华:将证书管理自动化(ACME/自动续期、OCSP Stapling),消除人为失误与过期风险。 3. 精华:在CDN边缘完成TLS终止、WAF与流量清洗,保证加速与安全双赢。 -

2026年4月8日

游戏资源cdn在多地区发布时的同步一致性与回源优化方法

1.概述与准备工作 目标:实现多地区 CDN 发布时内容一致且回源最小化。准备项:确认对象存储(如 S3/GCS/OSS)、CI/CD 工具、CDN 提供商支持的 API、版本控制流程与监控接入。小分段:列出账号/密钥、区域节点清单、测试域名。 2.架构建议(单源 + 边缘复制) 建议使用对象存储作为单一事实源(origin), -

2026年5月8日

云cdn加速免费在流媒体和图片分发场景下的表现评估

本文基于多维指标对若干主流免费云CDN服务在短视频/直播与静态图片分发两类典型场景中的表现进行了对比评估,涵盖请求成功率、首屏时间、播放连续性、缓存命中、带宽峰值限制与图像处理能力,并提出实用的测试方法与优化要点,帮助工程师在预算受限时做出合理抉择。 在评估< b>云cdn加速时,首要关注的是免费方案对并发连接数与月度流量的限制。多数免费产品在并发 -

2026年4月7日

项目经理必读 华为云海外cdn价格 优化带宽成本的实用技巧

华为云海外CDN常见计费方式包括按流量计费(按GB)、按带宽峰值计费以及包年包月/流量包模式。不同区域和运营商差异会导致华为云海外cdn价格存在波动,选择计费模式要结合业务流量稳定性和预算。流量计费适合不稳定突发流量,流量包更适合可预测的大量长期流量。 可通过华为云控制台的计费中心和价格试算器获取地域报价,结合历史访问日志做流量预测。利用成本中心设 -

2026年4月22日

海外域名cdn加速与证书部署的自动化流程实践和常见陷阱

1.概述与目标 目标:实现海外域名在全球加速、TLS自动化与基础DDoS防护的闭环。 场景:业务主站源站位于新加坡VPS,面向美、欧、亚用户。 指标:期望平均延迟 -

2026年4月2日

小网站cdn加速的费用费用费用包含哪些项目需要提前准备

1.总体费用项与准备清单 • 域名:注册与续费成本,国际域名与国内域名价格差异。 • 服务器/VPS:作为回源机的租用费用与配置影响性能。 • 带宽与流量:回源带宽与CDN外发流量两部分计费。 • CDN服务费:按流量、按峰值或按套餐计费,含请求数/流量双重计价。 • 安全与运维:SSL证书、DDoS防护、监控报警与备份成本。 • 预留预算:突 -

2026年3月22日

网站速度优化教程 专为奶爸建站设计的海外cdn加速流程

作为忙碌的奶爸在业余搭建网站时,核心目标是用最少时间达成最明显的用户体验提升。这篇文章概述了通过海外CDN接入、合理缓存、资源压缩和图片优化等手段,快速降低页面延迟并稳定站点访问,从选型、部署到验证给出可执行步骤,便于边带娃边优化站点。 为什么需要引入海外CDN,能带来哪些具体改善? 对海外用户或国内访问海外主机的场景,直接访问常常存在高延迟 -

2026年4月15日

cdn加速服务 海外在视频流媒体传输中的性能优化案例分析

1.背景与目标概述 • 项目背景:国内视频网站向海外用户提供点播与直播服务,主要面临跨境延迟高、抖动大、带宽成本高的问题。 • 目标一:将平均首包时间(TTFB)在海外节点降低至200ms以下。 • 目标二:将原站出网带宽使用量降低至少60%以节省成本。 • 目标三:提升缓存命中率至85%以上,减少源站CPU与I/O压力。 • 目标四:在遭受中 -

2026年4月23日

优化海外域名cdn加速的DNS配置与全球负载均衡实现方法

本文概述了面向海外用户提升域名访问速度与稳定性的实用做法,涵盖从DNS策略、CNAME与证书处理,到基于地理或延迟的全球流量调度(GSLB)、健康检查和监控优化等关键环节,给出可操作的配置要点与步骤,便于在多云或混合网络环境中部署和运维。 在为海外域名做加速时,应重点评估以下几个因素:一是DNS解析速度与分布,二是边缘节点(PoP)覆盖与对等互联,